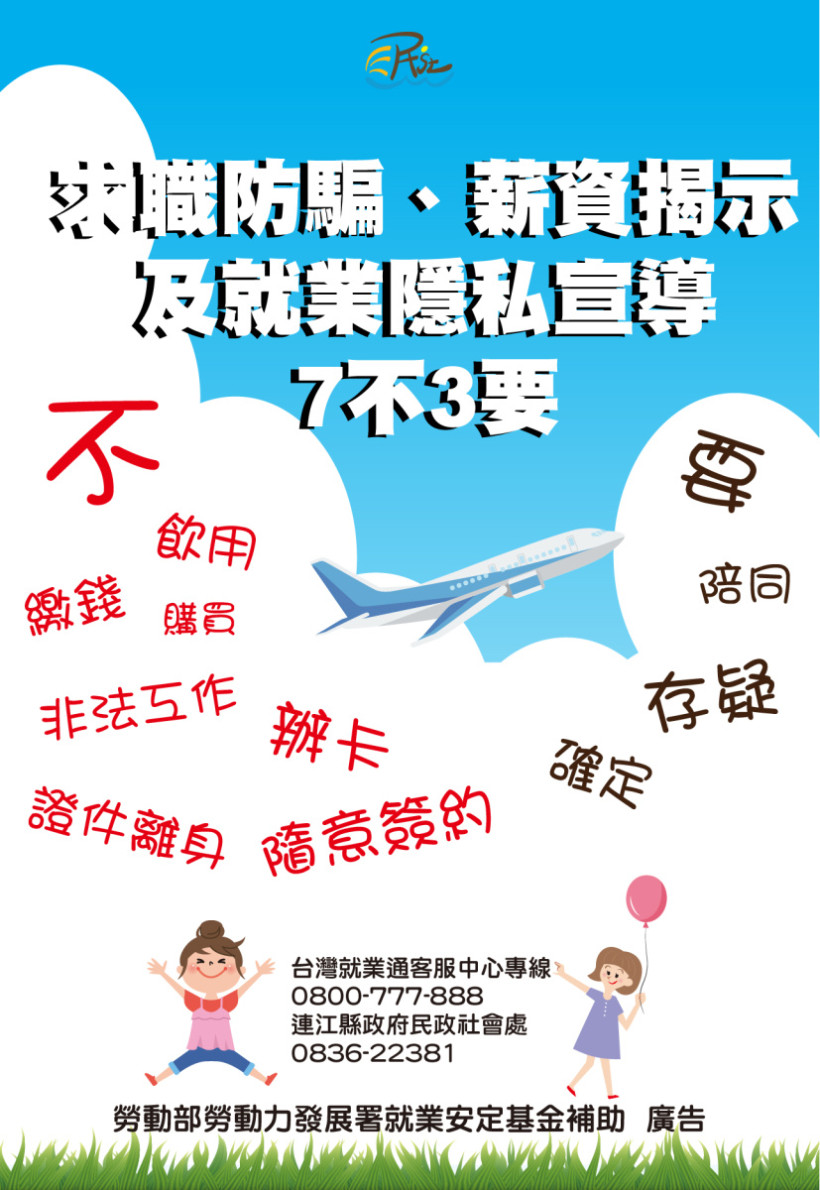

自2022年11月ChatGPT引爆生成式AI的熱潮以來,文字、圖像、語音和影片類的AI技術加速進化,在帶來生產力革命潛力的同時,也給了犯罪分子強大的工具。而且,到目前為止還沒有百分百能夠識別AI生成和真實之間區別的方法,所以時時保持懷疑是最好的防詐策略。人工智慧大發展的時代,文字、聲音、圖像、視頻都可能是AI合成的,即使眼見耳聞都有可能是假的,所以遇到轉帳匯款、資金往來的場景,一定要反覆核實確認,仔細檢查任何向你要錢或個人訊息的人。

自ChatGPT引爆生成式AI的熱潮,科技巨頭和創業公司爭先恐後地推出和升級AI產品。技術加速疊代,應用越來越便宜,而監管手段和力度一時難以應付,AI詐騙構成了迫切的挑戰。詐騙手段利用深度學習和影像合成,不只可操縱現有的媒體內容,進而達到換臉、變聲等效果,且愈來愈逼真。這類移花接木的「深偽技術」(deepfake),打破過往「耳聽為證、眼見為憑」的防詐守則,逐步發展為駭人的新興詐騙手法,可謂防不勝防。

根據分析與統計,詐騙集團近來有3類深偽手法。一是電話詐騙,早期詐騙集團仿冒家人、朋友或知名人士的聲音,謊稱被綁架,要求支付贖金到指定帳戶;或是「裝熟」,謊稱投資失敗、家裡有急用,向親朋好友索取金錢與個資,受害者常因欠缺查證,不疑有他而掉入陷阱。過往破解電話詐騙的方式,是採取「耳聽為證」,從口音中找尋破綻,但隨著深偽技術日趨精進,已接近真人發聲,光聽聲音已無法辨識是否為本人,只要詐騙集團手握完整的個人資料,民眾當下又無法聯繫到本人,就很難分辨真假。再者是挑戰「眼見為憑」的視訊詐騙。深偽技術的操縱者會利用合成擬真的影片、語音,或結合視訊功能,冒充進行詐騙。

警政單位建議,國人若遭到詐騙集團恐嚇,絕對不要害怕求助,更忌私下調解,成為被詐騙集團予取予求的肥羊。正確的作法是將文字、對話、日期時間、連結、影像等資訊「截圖存證」,並「立刻報警尋求警方協助」,最後則「求助iWIN網路內容防護機構」,協助移除遭合成影像,依正確步驟反制威脅。從當前的電信網路詐騙案件特徵看,轉帳匯款是必不可少的一環,因此「不聽不信不匯款」可謂是最好的終極防騙大招。

在這個數位化社會,人們在網路和社交媒體上活動越來越頻繁,每個人都在生成大量的數位化資訊,這為詐騙者提供了廣闊的操作空間,他們可以利用這些平臺,配合AI技術,進行大規模、精準的詐騙行為。國人在面對詐騙集團花招百出時,仍應時刻保持警惕和懷疑心態。在瀏覽各式資訊時,也應檢查來源的可信度,化被動為主動,確保訊息真實可靠,方能避免遭有心人士詐騙,不致輕易落入對方所設圈套,才能將遭詐的可能性阻斷於第一線。

社論/詐騙手法日益新 反覆查詢很重要

- 2023-06-27